Боротьба з ІДІЛ та підробленими акаунтами Facebook за допомогою фізики

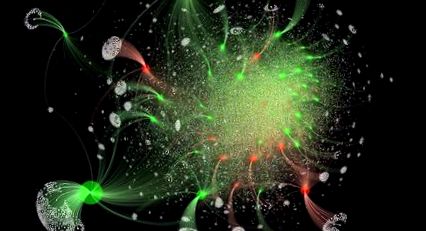

Ця графіка представляє мережу екстремізму та ненависті в соціальних мережах (наприклад, на підтримку ІДІЛ), яка показує, як люди об’єднуються в певні екстремістські ідеї та теми в певний день. Чорні крапки представляють кишені екстремізму/ненависті, білі крапки - це користувачі мережі, зв’язки яких відображаються як червоні посилання.

Н. Джонсон, П. Манріке та М. Чжен

(Inside Science) - наприкінці 2014 року та на початку 2015 року групи, прихильні ІДІЛ, розповсюдились у ВКонтакте, російській соціальній мережі в Інтернеті. За кілька місяців після свого заснування групи зібрали більше ста тисяч членів - у тому числі принаймні одного, який очолив битви ІДІЛ у Сирії.

Згідно з новим аналізом, поява цих груп, здавалося б, нізвідки, дуже нагадує те, як з'являється молочний сир. Дослідження, опубліковане минулого тижня в журналі Physical Review Letters, може допомогти правоохоронним та спецслужбам виявити екстремістські групи - і, можливо, навіть фальшиві акаунти в соціальних мережах, спрямовані на стимулювання розколу та розбрату, сказав Ніл Джонсон, фізик з університету Джорджа Вашингтона в Вашингтон, округ Колумбія, та один із авторів нової статті.

Для виготовлення та тестування моделі Джонсон та його колеги використовували дані ВКонтакте, зібрані під час бурхливої активності між 2014 і 2015 роками, перш ніж соціальна мережа закрила екстремістські групи. Останні кілька років команда моделює поведінку та еволюцію цих груп. Зараз, у новому дослідженні, вони продемонстрували, як починаються такі екстремістські групи.

Джонсон зрозумів, що раптова поява цих груп схожа на те, чому він навчився в аспірантурі: фізику гелів. Молочний сир - це тип гелю, і коли вони утворюються, мікроскопічні частинки молока скочуються одна на одну, поки в певний момент вони не стануть макроскопічними шматками. "Ви не помітно побачите жодної сирної маси", - сказав Джонсон. "Тоді є момент, що це просто з’являється з нізвідки". Дослідники взяли рівняння, що описують це явище, і застосували його до груп у соціальних мережах.

Але хоча згортання молока відбувається через скупчення білків, які схожі, люди різні. Отже, щоб імітувати це різноманіття, дослідники призначили число від 0 до 1, яке представляє "характер" людини. Джонсон сказав, що це спрощення, але справа в тому, щоб натякати на різноманітність соціальної мережі в реальному житті.

Апроксимація була досить хорошою, оскільки модель гелю точно відповідала даним ВКонтакте. Екстремістські групи, які вибухнули за кількістю та розмірами між 2014 і 2015 роками, накопичили послідовників, подібних до того, як частинки злипаються, утворюючи гелі. Дослідники могли навіть передбачити, коли будуть формуватися групи. Чим більше подібних людей за рівнем рейтингу "характеру", тим швидше вони об'єднуються в групи.

Це стрімке зростання властиве лише екстремістським угрупованням, сказав Джонсон. "Місцевий клуб карате не робить цього". Виявивши онлайн-групи, які поводяться як гелі, ви можете, в принципі, визначити групи, які мають більшу ймовірність розмноження екстремістської діяльності. З десятками тисяч онлайн-груп у ВКонтакте знайти кілька сотень екстремістських - члени яких часто спілкуються у коді та приховують свої мотиви - є складним завданням. Відфільтрувавши 1 відсоток, який може приховувати людей, які мають намір заподіяти шкоду, модель може звузити, які групи слід досліджувати, сказав Джонсон.

Завжди намагається передбачити, хто може заподіяти шкоду, сказав Пол Гілл, науковець із криміналітету в Лондонському університетському коледжі, який не брав участі в роботі. "У нас є обмежені ресурси і занадто багато шуму" в соціальних мережах, сказав він. "Наскільки моделі можуть допомогти, це спрямовувати наші обмежені ресурси до якомога меншої кількості груп".

Корисність моделі буде залежати від того, чи вона імітує поведінку інших груп в інших соціальних мережах, сказав Гілл, який вивчає, як люди з крайніми поглядами стають жорстокими. "Наступною великою проблемою зараз є збір даних про прихильників ІДІЛ на численних платформах соціальних медіа та огляд інших екстремістських груп, щоб зрозуміти, чи є тут щось, що можна узагальнити".

Зараз дослідники перетворюють свою модель на інші групи, такі як білі супрематисти, сказав Джонсон. Вони також аналізують, чи пристрасні групи, але погляди яких не обов'язково є жорстокими чи екстремістськими, також демонструють гелеподібне зростання. Якщо так, модель може допомогти вивести з підроблених акаунтів у соціальних мережах, призначених для розпалювання полум’я політичних пристрастей.

Наприклад, лише минулого тижня Facebook оголосив, що виявив 32 фальшиві акаунти, які намагаються зірвати та вплинути на вибори в США. Компанія не змогла підтвердити, хто несе відповідальність, але методи фальшивих профілів були подібні до методів Російського агентства Інтернет-досліджень.

Ці акаунти створювали сторінки та події, які містили вміст, який, мабуть, звертався до лівої політики та використовував сьогоднішній гарячий політичний клімат. Якщо такі сторінки та події справді зростатимуть як групи, що підтримують ІДІЛ, сказав Джонсон, тоді модель також може допомогти Facebook та державним установам ідентифікувати підроблені акаунти. Хоча ці політичні групи можуть бути не такими екстремальними або жорстокими, як групи, що підтримують ІДІЛ, вони можуть рости і поводитися подібним чином, залучаючи послідовників, спонуканих відчуттям терміновості та відчуттям, що вони піддаються нападу, сказав Джонсон.

Нова модель підкреслює важливість розгляду колективної поведінки, а не окремих людей, сказав він. Насправді, звичайна стратегія просіювання соціальних мереж для окремих терористів може бути помилковою.

Гілл погоджується, що вивчення поведінки в групі є важливим, тим більше, що налаштування групи можуть підбадьорити людей. "Рідко радикалізм або екстремізм трапляються самі собою", - сказав він. "Щоб зрозуміти радикалізацію та екстремізм, нам потрібно продовжувати дивитись на це через групову лінзу".

- Боротьба з ожирінням за допомогою науки про бактерії

- Знаменитості борються за кето-дієту

- Тенденція знаменитості; IV вітаміни; Не гарна ідея Ріанна Live Science

- Користь для здоров’я селери; Факти харчування Жива наука

- Дієтичні таблетки Шахрайство Підроблені веб-сайти жіночого здоров’я; Оголошення